Data & AIAI Strategy

打造 AI 的數據基礎:企業 AI 成功的隱藏關鍵

JRJonathan Rudich

•

儘管投資增加,70-80% AI 專案因數據品質和治理不佳而失敗。規模化 AI 的關鍵不是更聰明的模型,而是穩固的數據基礎。

開場:AI 價值悖論——為什麼大多數專案做不起來

企業界現在到處都在談 AI。2024 年 Forrester 調查顯示,67% 的 AI 決策者計劃明年增加投資。大家都在把 AI 導入核心業務。

但現實很殘酷。儘管話題很熱、預算很多,卻有驚人的 70-80% AI 專案失敗。這些專案卡在概念驗證(POC)階段,做不出實際商業價值。這就造成了「AI 價值悖論」:員工個人用 AI 工具確實更有生產力,但公司財報和整體經濟生產力完全沒改善。

本報告核心觀點很簡單:這些失敗不是因為 AI 演算法不夠好——現在的 AI 比以往更強大也更容易用。真正問題在於數據基礎沒打好。正如一項分析說的,AI 成功「是數據遊戲,不是程式碼競賽」。

數據品質和可用性問題一直是 AI 導入的最大障礙,也是企業在 POC 後放棄的主因。哈佛商業評論調查發現一個嚴重脫節:65% 組織認為 AI 很重要,但 54% 覺得自己數據基礎不夠,只有 10% 覺得「完全準備好」。這不只是技術問題,是策略失誤。

這份報告會告訴你:為什麼要從「以模型為中心」轉到「以數據為中心」,AI 專案怎麼失敗的、數據債務成本有多高,數據湖、湖倉、數據網格怎麼選,數據治理為什麼重要,自動化數據管道如何加速創造價值,以及真實案例證明投資數據基礎的回報。我們會用證據說明:企業 AI 成功的關鍵不在模型,在數據。

1. 從模型到數據:思維大轉變

過去十年,大家改善 AI 的方式是不斷調模型。把數據集當固定資產,主要精力花在改進模型程式碼和架構,讓它更會處理雜訊、從數據中找模式。這做法在學術界很主流,也確實帶來很多演算法進步。

但真實世界的企業數據不是實驗室裡乾淨整齊的基準測試集。它是混亂、動態、不一致的,反映複雜的業務運作。更重要的是,現在強大的模型架構(像 transformer)已經很普遍了。你可以透過開源專案和雲端 API 輕易取得。既然大家都能用類似的模型,競爭優勢在哪?答案是:在你擁有的獨特、高品質數據,以及你把這些數據整理好的能力。

什麼是以數據為中心的 AI

機器學習先驅吳恩達提出了以數據為中心的 AI (DCAI)。定義很直白:「系統性地把用來建 AI 的數據工程化」。做法完全倒過來:以前是數據固定、不斷調模型,現在是模型相對固定、系統性地改善數據。這不是建模前的「預處理」步驟,而是整個 AI 生命週期的核心——從開發、部署到維護,持續工程化數據。

導入以數據為中心策略需要整個組織改變運作方式。這不是丟給數據科學團隊的技術專案,是需要高層支持的變革管理。DCAI 的核心工作包括跟領域專家合作定義產品缺陷、在不同部門間達成標註標準共識、標準化工作流程,這些都是關於重新設計人們怎麼一起工作。這也是為什麼很多 AI 專案失敗:把 AI 當技術部署而不是業務轉型。首席數據長的角色要同時是外交官和教育者,在技術團隊和業務專家之間搭橋,讓數據變成全公司共享的資產。

以數據為中心的三個關鍵原則

第一個原則是系統化數據工程。不再靠個別數據科學家的運氣或技能做臨時的苦工,要建立可靠、高效、可重複的流程和工具,就像對待軟體開發一樣嚴謹:版本控制、文件記錄、自動化測試。

第二是專注數據品質和一致性。模型效能最關鍵的驅動力是數據一致性,特別是標註一致性。舉個例子:製造業裡,如果一個專家把藥丸缺陷標註為「碎裂」,另一個標註為「刮傷」,AI 就會被搞混,準確性就降低。以數據為中心的做法這樣解決:創建清楚的標註指示附邊界案例範例,用多個標註者找出不一致,讓領域專家直接參與確保標註正確。

第三是迭代改善數據。不是盲目收集越多數據越好,而是有針對性地改善。關鍵工作流程是先訓練基準模型,用錯誤分析找出模型表現差的特定數據,集中力量改善那些數據,然後重複。改善方式可以是重新標註、增加更多邊緣案例、移除雜訊數據。吳恩達說得好:「更多數據不總是更好!」這個訓練→分析→改善的循環,就是以數據為中心的引擎。

為什麼企業需要 DCAI

對消費者網路巨頭以外的產業特別重要。製造、醫療、政府、金融服務這些領域,數據常常更小、更專業、高度脈絡化。收集海量用戶數據、套用複雜模型的「大數據配方」在這裡不管用。製造商需要在自家產品影像上訓練的客製化模型偵測缺陷,醫院需要在自己電子病歷上訓練的客製化 AI。

關鍵是讓模型能用小而好的數據運作,不是只會吃大數據集。DCAI 提供工具和方法,系統性地把小而專業的數據集提升到能驅動準確 AI 系統的品質。這些產業有數萬個停滯的 AI 專案,每個價值 100 萬到 500 萬美元。DCAI 是讓它們動起來的唯一可行路徑。

2. 為什麼失敗:數據債務的真實代價

「垃圾進、垃圾出」是老掉牙的說法,但仍是 AI 失敗最好的解釋。但這說法太簡化了。問題更複雜。

你可以把數據問題想成債務。就像金融債務會產生利息,數據債務也會讓每個 AI 專案更貴、更慢、更容易失敗。這些問題不是單獨存在,它們互相影響,創造負面循環:數據孤島導致看不到完整數據,進而訓練出有偏見的模型,模型無法泛化到真實場景,對數據漂移變得超敏感。

這解釋了為什麼很多公司困在「試點陷阱」。第一個專案要克服數據債務的成本和努力太大了。等到想做第二、第三個專案,邊際成本越來越高而不是越來越低,因為基礎債務從沒還清。

失敗模式 1:嵌入偏見,決策出錯

AI 從數據學習。如果數據有偏見或代表性不足,模型不只會複製,還會放大這些問題。真實案例包括臉部辨識不成比例地誤認有色人種、主要在白人病患數據上訓練的醫療 AI 對其他族群診斷不準,以及 AI 招聘工具因訓練數據的關聯性系統性過濾掉某些背景的合格候選人。

這不只是道德問題,是重大商業風險。後果包括法律和監管危機(GDPR 等法規的巨額罰款)、聲譽損害,以及客戶、員工、合作夥伴的信任流失。

失敗模式 2:泛化不佳,困在試點

模型在概念驗證時表現很好,部署到真實環境就失敗。原因一是過度擬合:模型「記住」訓練數據的雜訊和怪癖,沒學到真正的模式,這在數據品質差時特別常見。原因二是邊緣案例疏忽:訓練數據乾淨但不夠全面,缺少罕見但關鍵的情境。例如自動駕駛在正常情況表現完美,但遇到訓練數據沒有的不尋常路障就危險地失敗。

結果就是「試點陷阱」——專案在實驗室成功但無法規模化,導致資源浪費、專案取消,以及對 AI 價值越來越懷疑。

失敗模式 3:數據孤島,營運癱瘓

大多數企業的數據不是統一的,而是分散在各處。「數據孤島」意思是關鍵資訊困在不同系統:CRM、計費系統、支援平台,這些系統常常不相容。更糟的是數據不一致——同一個客戶在每個系統名字拼法不同,日期和幣別用不同格式儲存。

這營運混亂讓 AI 專案陷入癱瘓。數據科學團隊報告花 80% 時間在「數據整理」——從不同來源找、清理、整合數據——而不是建模型。這嚴重拖累速度、推高成本。很多時候,數據問題太嚴重,在模型能訓練前就毀了專案。

失敗模式 4:數據漂移,模型衰退

AI 模型不是做好就永遠管用,它的表現跟處理的數據綁在一起。數據漂移是指生產環境的數據統計特性開始偏離訓練時的數據。這可能因客戶行為改變、新產品推出或市場條件轉變而發生。

數據漂移發生時,模型預測準確性隨時間下降(模型衰退)。例如詐欺偵測模型無法識別新詐欺手法,或需求預測在消費模式突變後變不準。沒有穩健數據基礎——包括持續監控和自動化重訓管道——你建 AI 的投資就浪費了。模型變成貶值資產,做出越來越糟的預測,導致糟糕決策。

3. 選數據架構:給決策者的指南

選數據架構不是 IT 部門的技術決定,是根本的商業決定。它決定你的組織能多敏捷、能多大規模、AI 治理能多有效。組織的架構選擇揭示它的 AI 文化準備度:怎麼控制、怎麼協作、怎麼問責。

如果公司只用技術解決數據儲存問題,不解決治理和文化挑戰,它還沒準備好做 AI。相反,如果能成功實施去中心化、領域驅動的架構,代表已經解決了很多讓 AI 沉船的組織和文化障礙。評估你今天能支援哪種架構,就能診斷你的真正 AI 成熟度。

架構 1:集中式數據湖

數據湖是集中儲存庫,用來存大量原始數據——結構化、半結構化、非結構化——保持原生格式。建在便宜的雲端儲存上(像 Amazon S3 或 Azure),採用「讀取時架構」——延遲到要用時才整理數據結構。

對 AI 來說,能容納訓練複雜模型需要的海量、多樣化數據集。從客戶交易到 IoT 感測器到社群媒體,全部集中在一個地方。但靈活性是雙面刃。沒有嚴謹治理,數據湖會變「數據沼澤」——組織混亂、文件記錄差、不值得信賴、數據品質糟糕。在這狀態下,為 AI 找和準備數據幾乎不可能,儲存庫變成負債。另外,集中式架構會造成瓶頸:單一中央數據團隊無法服務整個企業需求,導致延遲和沮喪。

架構 2:混合數據湖倉

數據湖倉融合數據湖和數據倉儲的優點:數據湖的低成本、可擴展、靈活,加上數據倉儲的可靠、治理強、效能好。Databricks 是這方面的領導者。

對 AI 來說,它提供單一統一平台處理所有數據、分析和 AI 工作,不用在不同系統間移動複製數據。支援 ACID 交易(原子性、一致性、隔離性、持久性),確保高數據完整性——訓練可靠 AI 模型的關鍵。設計上就是 AI 就緒:讓數據科學家能在單一環境無縫結合結構化數據與文字、影像等非結構化數據,大幅簡化工作流程。

架構 3:去中心化數據網格

數據網格不只是新架構,是思維大轉變。它拒絕集中式做法,採用圍繞業務領域組織的去中心化架構:行銷有自己的數據、銷售有自己的數據、供應鏈有自己的數據。

Zhamak Dehghani 提出四個核心原則。第一是領域導向所有權:最接近數據、最懂數據的團隊負責它。第二是數據即產品:每個領域把數據視為產品服務給其他人,數據必須可發現、可定址、值得信賴、有好文件。第三是自助數據平台:中央提供工具和基礎設施,讓領域團隊能自主建、部署、管理數據產品。第四是聯邦式治理:中央設標準和政策,但這些規則自動化並嵌入平台,領域自主運作同時確保企業級標準。

對 AI 來說,數據網格設計來處理大企業的複雜性和規模。賦予領域專家擁有數據產品,大幅改善數據品質、脈絡理解和可信度。數據存取民主化,數據科學和分析團隊能直接發現和使用高品質「數據產品」,不用通過中央瓶頸。這提供穩定的可靠、理解良好的數據流,對建準確模型很關鍵。特別對大型語言模型(LLM),用高保真、領域策劃的數據打底,能減少「幻覺」風險。

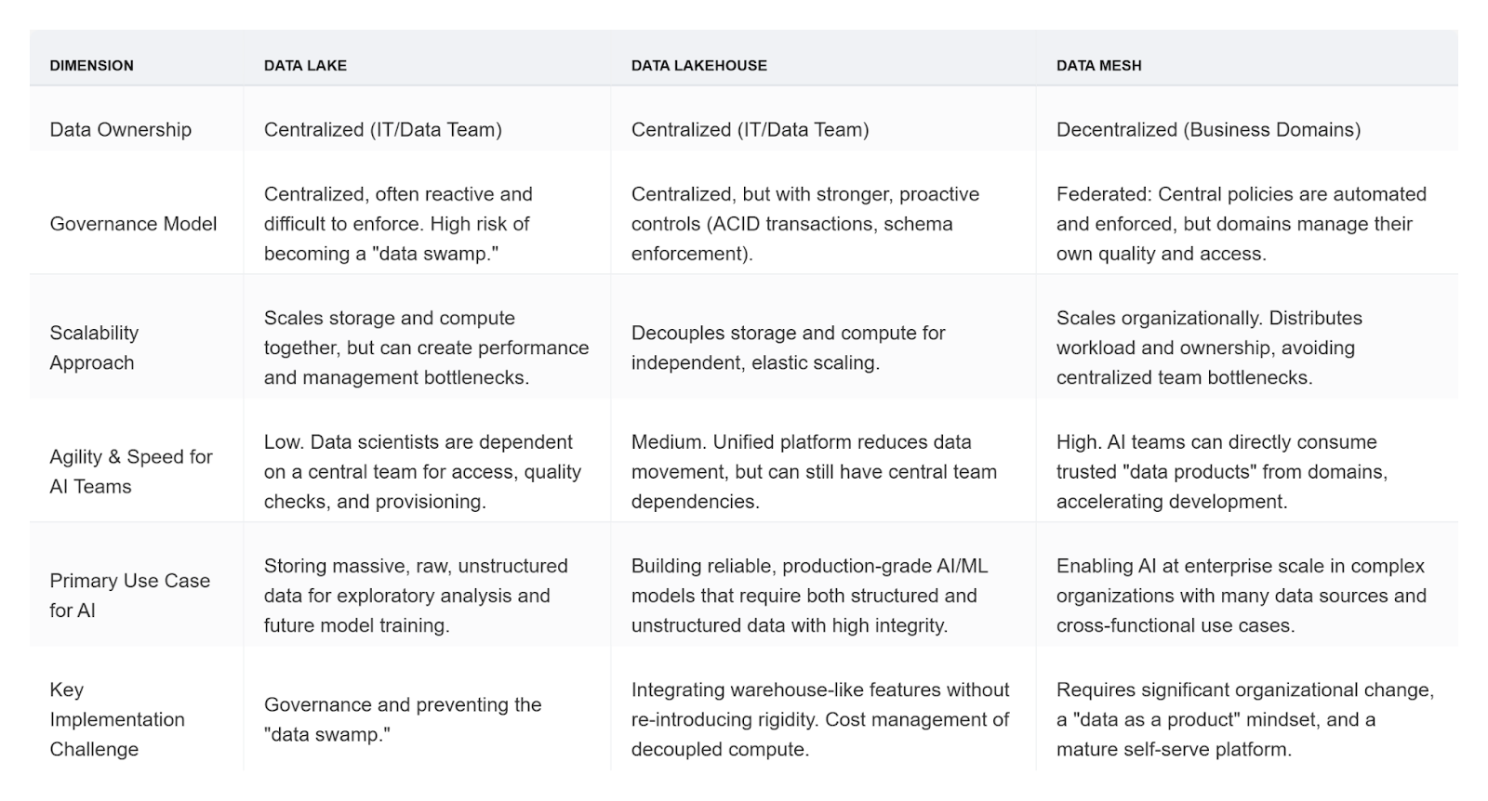

三種架構比較

為協助決策,這張表比較三種架構在企業 AI 的關鍵維度:

4. 數據治理:建立可信賴 AI 的基礎

在 AI 脈絡中,數據治理要重新定義。它不是減緩創新的限制或合規驅動的檢查清單,而是可信賴、可擴展、負責任 AI 的策略推手。成熟的數據治理是組織能否採用數據驅動創新的最強預測指標。強治理建立信任和可靠性,讓商業主管敢採用和推廣 AI 解決方案。沒有它,AI 就是高風險實驗。Gartner 預測警告:到 2027 年,60% 組織會因治理框架不連貫而無法實現 AI 用例的預期價值。

雞生蛋還是蛋生雞的困境

現代組織面臨 AI 治理的遞迴性質挑戰。一方面,高品質、受良好治理的數據是建可靠 AI 模型的先決條件——「為 AI 的治理」。另一方面,現代數據的量、速度、複雜性讓純手動治理不可能,組織需要 AI 工具來大規模自動化數據品質監控、政策執行、編目——「治理的 AI」。這創造可能癱瘓進展的困境。

解決方案不是完全解決一個再做另一個,而是迭代、演進。在最關鍵數據資產建立基礎(常是手動)治理實踐,用這「夠好」的數據訓練基本 AI 治理工具,這些工具的洞察和自動化幫助改善更多數據,用改善的數據開發更複雜 AI 治理能力。這創造良性循環——「治理飛輪」——逐漸同步成熟數據基礎和治理計劃。

現代 AI 治理的最佳實踐

有效治理從清楚的責任線開始。不是把治理丟給 IT,而是建專門的跨職能團隊,包括數據科學家、業務領導、合規官、法律專家。定義清楚角色:數據所有者對特定業務領域數據負責,數據管家負責數據品質、存取、合規日常管理。

實施數據品質框架是治理的營運核心。一套文件化的原則、標準、規則和工具,用來測量、監控、改善數據健康。對 AI 來說,框架要涵蓋多維度數據品質:傳統指標包括準確性、完整性、一致性、及時性,AI 特定維度包括相關性、有效性、公平性(偵測和減輕偏見)。

整合負責任 AI 原則同樣重要。AI 治理要超越技術數據品質,涵蓋模型開發和部署的倫理影響。核心原則包括公平性和偏見減輕(主動測試並減輕數據和模型中的偏見)、透明性和可解釋性(確保 AI 決策過程可理解、可審查,盡量避免「黑盒」),以及隱私和數據保護(實施穩健安全和隱私協定,保護敏感數據並遵守法規)。

當數據源成長到數千個時,手動治理不可行。現代框架要用技術擴展,用 AI 工具自動化關鍵治理任務:數據發現和編目、持續數據品質監控、異常偵測、存取和隱私政策執行。自動化讓治理變主動而非被動,在問題影響 AI 模型前就標記它們。

最終,治理不只是政策和工具,是改變行為。成功的治理計劃需要有意識努力在全組織培養數據驅動文化。投資持續培訓和數據素養計劃,確保所有員工——從高管到第一線分析師——都理解管理良好數據的策略價值,並認識他們在維護數據品質和治理標準中的角色。

5. 飛輪效應:用自動化加速創造價值

數據管道是 AI 的循環系統。它自動化數據從收集到訓練模型的流動,包括數據攝取、清理、轉換、特徵工程、載入機器學習模型等關鍵步驟。管道的效率和可靠性直接決定 AI 開發的速度和成功。慢、脆弱、不可靠的管道是主要限制,快、穩健、自動化的管道是強大加速器。

以數據為中心的 AI 本質上是持續迭代:訓練模型→分析錯誤→改善數據→重複。這循環只有在數據管道自動化時才能在企業規模實用。每個「改善數據」步驟都需要改管道——新增清理規則、轉換特徵、擴充數據子集。如果每次改變都是手動、多週的努力,反饋循環太慢無法有效。數據科學家可能發現關鍵數據問題,但等到管道手動更新時,商業脈絡可能已經變了。數據管道自動化是讓 DCAI 循環快速旋轉以交付價值的引擎,讓數據科學家和領域專家能快速可靠地實施改善,不被工程積壓卡住。

手動管道的問題

以前,數據管道用手動腳本和零散工具拼湊。這在現代數據環境不行了。手動管道超級脆弱——來源數據格式小改變可能讓整個管道靜默失敗。它們也勞力密集,需要巨大工程努力建立、除錯、維護、更新。這嚴重拖累 AI 專案,消耗資源、引入長延遲、扼殺創新。

自動化的力量

現代數據管道自動化平台提供智慧控制層,集中且自主編排從來源到消費的整個工作流程。在單一統一介面整合所有步驟,交付變革性效益。

自動化能減少生產分析就緒數據需要的工程努力高達 90%。數據團隊從低階除錯和維護解放,能專注更高價值活動:跟商業主管協作、開發新數據產品。透過智慧管理和優化數據處理,自動化消除冗餘計算並減少浪費雲端資源。組織報告實施後數據轉換和處理的雲端成本降低 30% 或更多。

自動化也消除人為錯誤風險——這是數據品質問題和管道失敗的常見來源。確保數據每次都一致可靠處理。自動化數據品質規則和檢查嵌入管道每階段,在壞數據能損壞 AI 模型前就自動標記或隔離它。

AI 驅動的自動化:下一個前沿

最先進平台現在用 AI 管理和優化管道本身,創造自我改善系統。機器學習模型分析歷史管道效能和系統指標,在失敗發生前預期它們,識別常見問題(如資源瓶頸或 API 超時)之前的模式,實現主動介入。

AI 演算法持續監控管道效能指標(如數據量和轉換複雜性),基於即時反饋動態調整處理參數:重新分區任務、修改資源配置,確保管道在數據量成長和需求演變時維持峰值效率。

最新前沿是用生成式 AI 加速管道創建。這些工具能分析用自然語言表達的業務需求,自動生成常見數據轉換和整合任務的優化程式碼,大幅減少開發時間並確保遵守最佳實踐。

6. 真實回報:數據基礎的財務證據

投資數據基礎的真正價值不是看單一 AI 專案,而是看它如何降低每個後續專案的成本和時間。強大數據基礎把 AI 開發從一系列昂貴、一次性手工專案,轉變為可擴展、可重複的工業流程——「AI 工廠」,數據基礎就是組裝線。以下真實案例和可量化指標證明:精心打造的數據基礎直接連接到商業價值、效率和財務表現。

指標 1:更快創造價值

穩固數據基礎的主要好處是大幅加速 AI 專案時程。消除數據整理、整合、品質問題,組織能直接從概念移到創造價值。建在強數據基礎上、用 AI 引導採用策略的企業,創造價值速度快 3 倍。行銷技術提供商從一開始確保數據乾淨可存取,展示快 3 倍創造價值。全球金融科技企業專注可擴展架構和創建 AI 就緒團隊,只花 90 天就把生成式 AI 願景轉為生產級創新工作室。

指標 2:改善營運效率和成本節省

乾淨、可存取、整合的數據讓 AI 能自動化複雜流程、優化資源配置,驅動顯著效率和成本降低。

Domina(哥倫比亞物流公司)在統一數據基礎上建 AI 平台來預測包裹退貨並自動化配送驗證,結果配送效果提升 15%、即時數據存取改善 80%,完全消除手動報告生成時間。約翰霍普金斯醫院實施 AI 控制中心整合即時床位可用性和病患臨床數據,讓醫院分配床位快 30%、急診室等待時間減 20%、手術病患在恢復室等待需求減 80%。Woven(豐田)在現代數據架構建自動駕駛開發平台,總擁有成本降低 50%。Forrester 研究發現使用建在統一數據的現代安全平台,三年 240% 投資回報率,淨現值 430 萬美元。

指標 3:增強模型效能和商業影響

數據基礎品質直接轉化為 AI 模型準確性,驅動可衡量商業結果:營收成長、成本降低、競爭優勢。哈佛商業評論研究證實,「數據到價值領導者」——擁有強數據基礎的組織——在獲利能力、市占率、客戶滿意度顯著優於同儕。

Moglix(印度數位供應鏈平台)在數據平台部署生成式 AI 供應商發現工具,採購團隊效率提升 4 倍,季度業務從 12 千萬盧比增到 50 千萬盧比。Miinto(電商市集)用 AI 視覺模型識別並合併重複產品清單,大規模清理產品數據後營運效率提升 40%、客戶轉換率改善 20%。美國運通用高品質交易數據驅動機器學習詐欺偵測,每年防止超過 20 億美元詐欺損失。一家航太製造商面臨頻繁衛星通訊失敗,問題根源於低品質、不同數據來源,採用以數據為中心做法用程式化標註系統性改善數據後,建立高效 AI 故障偵測工具,把數據障礙轉為高價值資產。

證據清楚:對數據基礎的投資不是預備工作,是 AI 成功和財務回報的主要驅動力。

結論:你的 AI 就緒數據基礎藍圖

通往企業 AI 成功的路,起點和終點都是數據。AI 價值悖論不是無解之謎,它是策略失誤的結果:專注先進模型的誘惑,忽視支撐它們的數據基礎。本報告證據很清楚:系統性建立穩健、可靠、受良好治理數據基礎的組織,解鎖 AI 真正變革潛力,達成更快創造價值、更高營運效率、可持續競爭優勢。

給高管的行動藍圖

對為組織規劃路線的高管和顧問,前進道路需要刻意和有紀律的做法。這藍圖提供高層路線圖引導這關鍵轉型。

第一步是坦誠且全面審計組織數據成熟度。關鍵問題不是「我們準備好 AI 了嗎?」而是「我們最大的數據治理、品質、可存取性差距在哪?」評估要超越 IT 系統,看創造和延續數據債務的文化和流程挑戰。

轉向以數據為中心是領導挑戰,不是技術挑戰。需要高管倡導者能闡述令人信服的願景:數據是核心業務產品,不只是 IT 資產。這涉及重新定義角色、為跨職能協作創造激勵、投資企業級數據素養、建立對數據品質共同問責的文化。

選數據架構是必須與組織規模、複雜性、文化準備度對齊的長期決策。評估數據湖、湖倉、數據網格,不是作為競爭技術,而是作為企業數據的不同營運模式。這選擇反映並塑造組織敏捷且大規模創新的能力。

最後,把數據治理框架和數據管道自動化平台視為同一枚硬幣兩面,它們要一起規劃、資助、實施。穩健治理提供「什麼」——值得信賴數據的規則、標準、政策。先進自動化提供「如何」——在企業範圍執行標準的可擴展、高效、可靠手段。缺一不可,無法大規模實現值得信賴的 AI。

對數據基礎的投資不是成本中心。它是組織能做的最關鍵策略投資,確保它不只生存而是在 AI 時代茁壯。它是解鎖可持續、長期價值,把 AI 承諾轉為有形商業現實的隱藏關鍵。

訪問 Alpha Technical Solutions 了解更多並預訂免費策略討論。讓我們幫你把 AI 承諾轉變為有形商業現實。