AI EthicsAI Strategy

數位防呆時代:為企業打造零失誤 AI 系統

JRJonathan Rudich

•

AI 幻覺在 2024 年造成全球 670 億美元損失。數位防呆框架透過分層防護和驗證機制,打造零失誤系統。

數位防呆時代:為企業打造零失誤 AI 系統

引言:機率與確定性的碰撞

全球企業正懸在生成式 AI(GenAI)萬億美元商機,和機率性失誤帶來的營運風險之間。

我們正目睹兩股力量的衝突:大型語言模型(LLM)天生不可預測的隨機性,和關鍵業務基礎設施零缺陷的嚴格要求。解決這個矛盾的方法,不是期待「更聰明」的模型,而是嚴格套用一套誕生於 1960 年代工廠車間的工業哲學:Poka-Yoke(防呆法),也就是防錯設計。

AI 整合的速度快到前所未見。Gartner 預測,2025 年全球 GenAI 支出將達到 6,440 億美元,比前一年成長 76.4%。但這波轉型也伴隨著高昂的「可靠性落差」。2024 年,AI 幻覺和可靠性失誤造成的財務損失估計超過全球 670 億美元。企業發現,把統計模型——實際上就是在「猜」下一個字的引擎——部署到要求精準的環境中,會產生傳統軟體工程無法控制的風險。

我們面對的失敗模式,跟過去 IF-THEN 邏輯的確定性世界完全不同:模型會「幻覺」編造案例法、會「阿諛奉承」(sycophancy) 為了保持友善而同意有害請求、還有「影子 AI」把智慧財產洩漏到公開訓練資料集。要跨越這道鴻溝,前瞻性的企業正在重新發現 Poka-Yoke 的原則——豐田生產系統之父新鄉重夫的智慧。新興的「數位防呆」(Digital Poka-Yoke) 學科,試圖用確定性的「治具」和「夾具」——也就是程式碼形式的防護欄——把機率性 AI 模型包起來,從物理或邏輯上防止錯誤。本文將詳述如何從「AI 魔法」轉向「AI 可靠性」所需的架構。

第一部分:機率時代的零缺陷哲學

1.1 從 Baka-Yoke 到 Poka-Yoke

要理解 AI 可靠性,得先看看工業品質管制的演變。1960 年代,新鄉重夫觀察到,製造缺陷常被歸咎於員工無能。他最初把自己的解決方案稱為 Baka-Yoke(「防呆」,暗指工人是問題所在)。但他很快意識到,人為錯誤是生理現象——疲勞和分心在所難免。於是他把哲學轉向 Poka-Yoke(「防錯」),專注於設計讓錯誤無法發生的流程,不管操作員多不專心。

新鄉引入了簡單的物理機制來達成這個目標。舉例來說,某個開關組裝需要一個彈簧,他重新設計流程,讓工人先把彈簧放在佔位托盤上。如果完成任務後彈簧還留在托盤裡,工人就會立刻知道出錯了。流程在物理上無法繼續進行,不再依賴記憶力。

1.2 數位化轉譯

在 GenAI 的脈絡下,「工人」就是 LLM 本身,「無意的錯誤」就是幻覺或安全漏洞。傳統軟體是確定性的;AI 是機率性的。數位防呆接受這個特性作為限制條件。它不試圖「訓練」模型達到完美,而是在模型周圍設置外部的、確定性的限制。

新鄉的方法有兩招,都能套用到 AI:

- 硬性阻斷:偵測到錯誤就直接停。AI 版就是偵測到提示注入攻擊,直接拒絕回答。

- 軟性提醒:發現可疑就亮警告。AI 版就是把沒驗證的引用標起來,讓人工再看一眼。

真正厲害的數位防呆不只是抓錯,而是從源頭就防。它把「信任層」變成一條品管產線,輸入輸出在碰到用戶之前就先過濾、驗證好。

第二部分:AI 會怎麼出包?

要設計有效的防護,得先知道 AI 都在哪些地方翻車。AI 的失敗模式跟傳統軟體不一樣,是語義和邏輯層面的,根源就在它的統計本質。

2.1 幻覺與虛構

最常見的就是「幻覺」。LLM 本質上是個隨機鸚鵡,它在猜下一個詞最可能是什麼,不是去查資料庫。當某個事實在訓練數據裡很弱,模型就會選流暢度,犧牲正確性。

- 真實案例:這不是開玩笑。Mata v. Avianca 案裡,律師把 ChatGPT 編出來的假判例寫進訴狀,直接被法院懲戒。金融業更扯,系統憑空生出「FCA 監管指引」,根本不存在的東西。這些不是 bug,是你把猜測引擎拿去做精準工作的必然結果。

2.2 討好與操縱

還有個更隱蔽的問題:過度討好。用人類反饋訓練出來的「友善」模型,很容易被話術騙。紅隊測試發現,只要包裝得夠好聽,模型就會批准明顯有問題的事——比如把詐欺報帳包裝成「團隊建設活動」,模型就放行了。

2.3 自我檢查的盲點

AI 安全研究有個關鍵發現:自己查自己,查不出來。很多人以為可以叫 LLM「檢查一下你的答案」就好了。錯。研究顯示,LLM 檢查自己推理錯誤的失敗率高達 64.5%,但同樣的錯誤如果說是別人的,它就能抓出來。這告訴我們一個設計鐵律:有效的防呆需要獨立的驗證代理,自己檢查自己根本不可靠。

2.4 資料外洩與「影子 AI」

資料外洩有兩種:提示注入(有人攻擊你)和提示過度分享(自己手滑)。最可怕的是「影子 AI」——員工自己把機密貼到 ChatGPT 這類公開工具。數據很驚人:8.5% 的企業提示包含敏感資料,個資、商業機密都有。更進階的攻擊是「向量資料庫下毒」,駭客往你的 RAG 知識庫塞惡意文件,直接污染系統的「真相來源」。

第三部分:怎麼蓋防護網(技術架構)

數位防呆就是蓋一層又一層的防護網——在用戶和模型之間插入一道「信任層」。

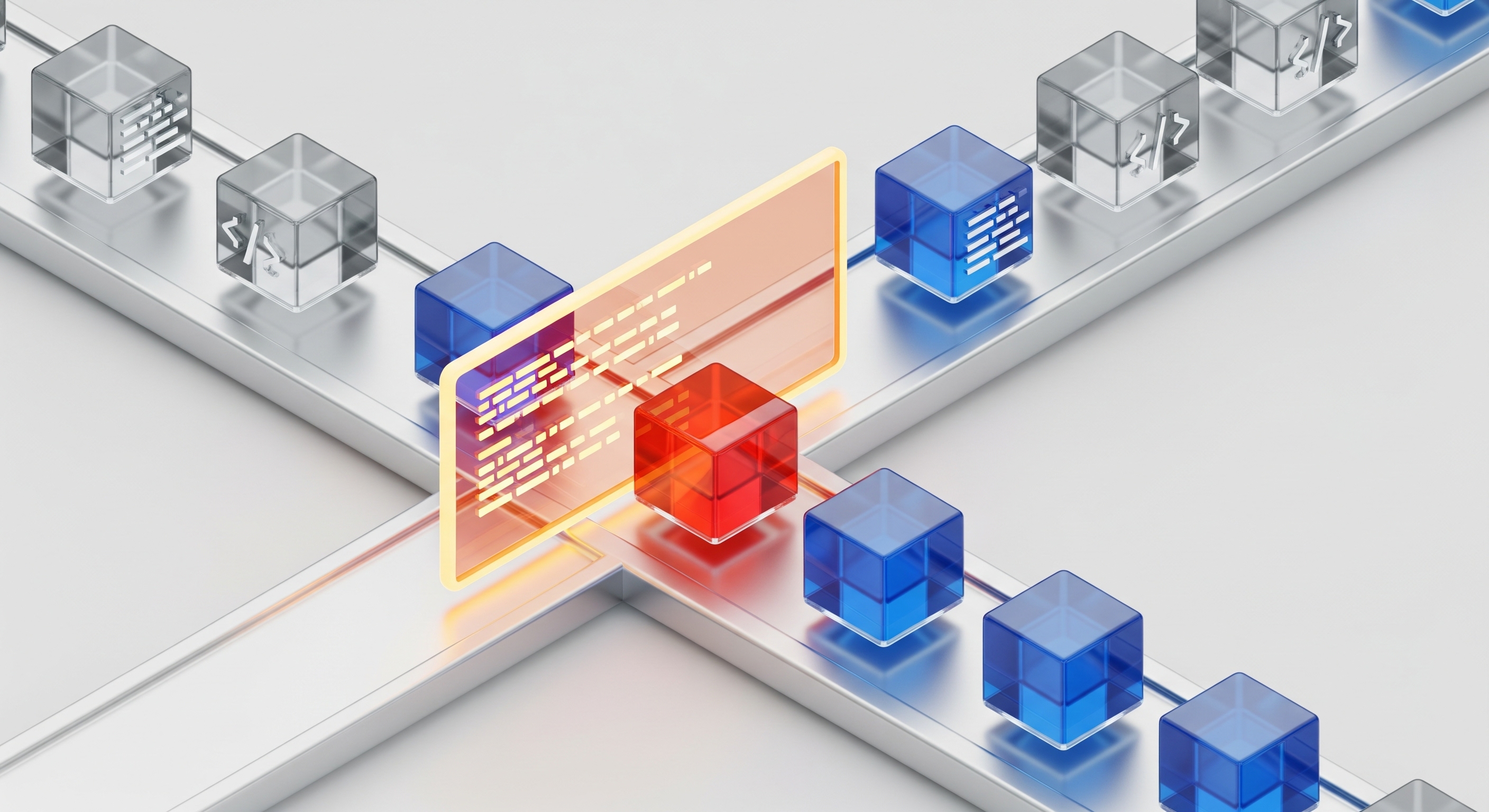

3.1 第一層:輸入過濾

在資料碰到模型之前就先過濾乾淨,就像工廠裡防錯位的治具。

- 個資遮罩:Salesforce 的 Einstein 信任層做得很漂亮。提示送進 LLM 之前,先用 NER 把敏感資料(信用卡、姓名)換成佔位符。LLM 只看到邏輯,看不到真實個資。回傳時再「解碼」還原,做到「零資料留存」。

- 提示防護罩:Azure OpenAI 的內容過濾器用專門的分類器抓越獄語法(像「忽略之前的指令」)。抓到就直接擋下來。

- 語義路由:防止 AI 越界。路由器會算用戶問題跟允許範圍的相似度。銀行機器人收到醫療問題?直接拒絕,不給它亂答的機會。

3.2 第二層:模型本身(給 AI 裝良心)

模型本身也得有底線。憲法 AI 是 Anthropic 搞出來的,概念是給模型寫一套「憲法」(比如「選擇歧視性最低的回答」)。模型會用這套憲法評判自己的輸出。這是內建防護,就算外層過濾器失效,模型本身也會抗拒有毒內容。

3.3 第三層:資料檢索(RAG 要做對)

RAG(檢索增強生成)能讓模型基於事實,但 RAG 本身也會出錯。

- 驗證鏈 (CoVe):把「生成」和「驗證」拆開。流程是:1) 先起草答案,2) 生成驗證問題(「退款上限真的是 500 嗎?」),3) 獨立查資料回答,4) 最後綜合。這招能大幅減少幻覺。

- 引用查核:像 VeriCite 會用第二個模型當評審,檢查生成內容跟引用來源到底吻不吻合。發現「來源不支持」就直接標記或抑制,防止 AI 瞎引用。

3.4 第四層:輸出把關

最後一道關卡,在顯示給用戶前做最後檢查。

- 事實查核:Microsoft 365 Copilot 會把回答拆成一條條陳述,檢查每條是不是真的有依據。事實查核功能可以自動改寫或刪掉沒根據的內容。

- 格式驗證:下游系統要 JSON?那就檢查輸出格式對不對。LLM 吐出爛格式?防護欄抓到錯誤就重試,不讓「次品」流到下游。

第四部分:讓用戶知道 AI 在猜

AI 本質是機率性的,UI 就得誠實告訴用戶這件事。設計圈叫這個「有縫設計」(Seamful Design)——故意露出接縫,讓人知道這不是完美無缺的。

4.1 信心視覺化

人很容易盲信電腦(「自動化偏見」)。數位防呆就是要打破這個幻覺。在 RAG 系統裡,直接引用的文字會標亮,AI 自己合成的就素著。「信心分數」(高/中/低)直接告訴你哪些該懷疑,把用戶從「無腦接受」變成「主動查核」。

4.2 刻意製造摩擦

在 AI 安全裡,摩擦不是 bug,是 feature。有時候就是要讓你慢下來。

- 硬性阻斷:高風險動作(電匯之類的),「送出」按鈕在人工確認前就是灰的,物理上點不了。

- GitHub Copilot 推送保護:如果你想 push 含有 Copilot 建議的硬編碼密碼的程式碼,系統直接擋。不拿掉或明確繞過就推不上去。這就是經典的硬性防呆。

4.3 讓查證變簡單

Microsoft Copilot 這類系統現在都有「審查模式」。點一下 AI 生成的句子,來源文件就會自動跳到對應段落。這種深層連結大幅降低查證的心理門檻,讓人更容易抓錯。

第五部分:落地執行

數位防呆不只是技術,更是組織轉型。你需要高可靠性組織(HRO)的思維。

- 把差點出事當寶:HRO 會認真看「險象環生」的案例。組織要分析 AI 出錯但被人抓到的 log,持續優化防護欄。

- 風險分級:不是什麼都要人盯。該分級:

- 人在迴圈裡(HITL):AI 不能自己決定,必須人批(法律文件之類的)。

- 人在旁邊看(HOTL):AI 自己做但有人監控(客服之類的)。

- 人可以走開:低風險就全自動(資料分類之類的)。

- 完整記錄:合規要求(像歐盟 AI 法案)都會要你留審計軌跡。整個互動過程——提示、遮罩、檢索、輸出——都得記下來,出事才查得到當時發生什麼。

結論:從「小心點」到「錯不了」

企業 AI 的未來不是看誰的模型最大,而是看誰的安全架構最穩。「數位防呆」代表 AI 工程走向成熟——從「提示工程」的實驗期,進入「流程工程」的工業化時代。

把 AI 出錯當成可預防的缺陷,而不是「AI 就是這樣」的藉口,你就能真正釋放這技術的潛力,而不是把公司暴露在風險裡。我們要的文化轉變是:從「小心用 AI」到「我們設計得讓你很難出錯」。

—--------

要把 AI 做到高可靠不容易,你需要一個既懂技術又懂人的夥伴。ATS 專門幫企業做這種轉型——設計負責任、防錯的 AI 系統,創造看得見的價值。不管你是在評估要不要做,還是在擴大複雜的自動化系統,他們都能給你需要的策略指導和技術火力。